Chiến tranh hiện đại và sự phụ thuộc trí tuệ nhân tạo

Cuộc xung đột diễn ra tại Trung Đông cho thấy mức độ phụ thuộc ngày càng cao của quân đội Mỹ và Israel vào trí tuệ nhân tạo (AI) trong lĩnh vực quân sự, đặc biệt là trong việc xác định mục tiêu và lập kế hoạch tấn công.

Vụ ném bom trường nữ sinh ở Minab ngày 28/2 được cho là nhầm lẫn trong việc xác định mục tiêu, khiến khoảng 170 người thiệt mạng, chủ yếu là trẻ em, đã làm nổi bật các rủi ro pháp lý, những lỗ hổng của hệ thống và vấn đề trách nhiệm.

Cuộc xung đột chống lại Iran do Washington và Tel Aviv phát động nhanh chóng được gọi là “cuộc chiến AI đầu tiên”. Tuy nhiên, nhận định này thực tế có thể gây hiểu lầm trên nhiều phương diện. Không chỉ vì AI đã sử dụng rộng rãi trong các cuộc xung đột gần đây, đặc biệt là bởi Israel tại Gaza, mà rộng hơn, với tư cách là một công cụ số để xử lý và phân tích dữ liệu, AI đã có lịch sử lâu dài gắn liền với các cuộc chiến tranh, với nền tảng kỹ thuật có thể truy ngược về thời kỳ Thế chiến II.

Dù vậy, tình hình tại Iran vẫn có những điểm khác biệt, nổi bật ở mức độ tinh vi chưa từng có của các công nghệ được sử dụng và sự phụ thuộc của các lực lượng quân sự vào chúng. Nó cũng khác với xung đột tại Gaza ở chỗ lần này AI được triển khai chống lại đối thủ là một quốc gia trong bối cảnh chiến tranh cường độ cao. Cuối cùng, chưa bao giờ các quốc gia lại công khai đến vậy trong việc sử dụng các hệ thống này. Chính sự công khai đó, kết hợp với những hậu quả bi thảm của các cuộc không kích, đã đặt ra câu hỏi về mức độ phù hợp của thực tiễn với luật pháp quốc tế.

AI thực chiến tại Trung Đông

Việc Israel sử dụng AI trong cuộc chiến chống Hamas trước đây đã được Tạp chí trực tuyến +972 (có trụ sở tại Israel) tiết lộ. Tờ báo độc lập này đã phơi bày điều mà nhiều chuyên gia đã nghi ngờ từ vài năm nay. Tuy nhiên, trong trường hợp xung đột tại Iran, chính các nhà chức trách Mỹ lại là bên công khai việc sử dụng AI.

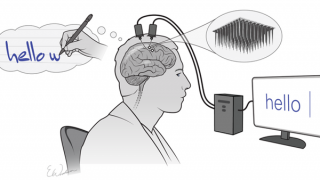

Quân đội Mỹ đã thừa nhận việc sử dụng các hệ thống AI để xây dựng và sàng lọc danh sách mục tiêu với tốc độ cực nhanh. Quy trình này đã dẫn đến hơn 1.000 cuộc không kích, được mô tả là có độ chính xác cao, chỉ trong 24 giờ đầu tiên của cuộc xung đột. Lầu Năm Góc được cho là đã sử dụng hệ thống công nghệ quân sự Maven - dự án kết hợp phần mềm AI của công ty công nghệ Palantir chuyên về phân tích dữ liệu lớn - cùng với hệ thống AI tạo sinh Claude (giống ChatGPT) do Anthropic phát triển.

Tuy nhiên, ngay trong ngày đầu tiên của cuộc chiến, Mỹ đã gây ra vụ không kích vào trường học ở Minab. Nhà Trắng đã thừa nhận trách nhiệm đối với vụ tấn công này và cho rằng đó là sai sót. Ngôi trường thực tế nằm gần một căn cứ hải quân của Lực lượng Vệ binh Cách mạng Hồi giáo Iran (IRGC) và từng là một phần của cùng khu phức hợp trước khi được tách ra. Vì vậy, thông tin không được cập nhật đã dẫn đến việc phê duyệt cuộc tấn công.

Sai lầm như vậy không phải là chuyện nhỏ. Nhiều cơ quan truyền thông và các tổ chức phi chính phủ đã nhanh chóng chỉ ra mối liên hệ giữa ngôi trường và căn cứ hải quân. Theo đó, có ý kiến cho rằng quân đội Mỹ có thể đã nhắm vào tòa nhà này dựa trên dữ liệu lỗi thời, khi làm theo một khuyến nghị từ hệ thống AI mà không thực hiện các bước kiểm chứng cần thiết.

Tính hợp pháp của việc sử dụng AI cho mục đích quân sự

Theo luật pháp quốc tế, việc sử dụng AI để tiến hành các cuộc không kích này, cũng như sai sót đã xảy ra, có hợp pháp không? Trước hết, cần làm rõ bản thân AI không bị cấm sử dụng theo LAC (Luật Nhân đạo quốc tế). Cho đến nay, chưa có quy định pháp lý nào trực tiếp điều chỉnh riêng vấn đề tính hợp pháp của AI. Tuy nhiên, điều đó không có nghĩa là tồn tại một “khoảng trống pháp lý”. Các quy tắc chung của LAC vẫn áp dụng đối với cách thức tiến hành chiến sự, bất kể phương tiện hay phương pháp được sử dụng là gì.

Một trong những nguyên tắc cốt lõi là “nguyên tắc phân biệt”, theo đó chỉ các mục tiêu quân sự mới được phép bị tấn công, còn dân thường và tài sản dân sự phải được bảo vệ. Do đó, việc trực tiếp nhắm vào một trường học như vụ việc ở Minab, nếu không có mục tiêu quân sự bên trong, sẽ cấu thành hành động vi phạm rõ ràng nguyên tắc này.

Vi phạm ở đây nhiều khả năng liên quan đến nguyên tắc thận trọng. Nguyên tắc này yêu cầu các bên tham chiến phải thực hiện mọi biện pháp khả thi để xác minh các mục tiêu bị tấn công thực sự là mục tiêu quân sự. Trong trường hợp này, quân đội Mỹ dường như đã không tiến hành đầy đủ các bước kiểm chứng cần thiết để xác định mục tiêu thực chất là một trường học. Một kiểm tra cơ bản, như cách một số cơ quan truyền thông đã thực hiện, có thể đã nhanh chóng làm rõ tình hình được.

Trong cuộc chiến tại Gaza, từng có thông tin cho thấy binh sĩ Israel đôi khi chỉ có khoảng 20 giây để phê duyệt một mục tiêu, điều này đặt ra nghi vấn về khả năng thực sự tuân thủ nguyên tắc thận trọng. Những lo ngại về AI quân sự thường tập trung vào mức độ tự chủ và nguy cơ hệ thống tự lựa chọn và tấn công mục tiêu - tức vấn đề vũ khí tự động sát thương. Tuy nhiên, ví dụ này cho thấy ngay cả khi vẫn duy trì sự kiểm soát của con người về mặt hình thức, thì sự kiểm soát đó có thể chỉ mang tính danh nghĩa nếu người vận hành không có đủ thời gian hoặc khả năng phản biện cần thiết để đánh giá các khuyến nghị từ thuật toán.

Về phía Iran, thì nguyên tắc thận trọng không phải chỉ áp dụng cho bên tấn công. Nó còn yêu cầu bên bị tấn công phải thực hiện các biện pháp phòng ngừa chủ động, chẳng hạn như di dời dân thường và tài sản dân sự ra khỏi các mục tiêu quân sự. Trong trường hợp này, việc chuyển đổi một công trình thuộc căn cứ hải quân thành trường học nhưng vẫn giữ nó trong khu vực gần kề với cơ sở quân sự đã khiến công trình dân sự này bị đặt vào nguy hiểm trong bối cảnh chiến sự.

Trách nhiệm pháp lý, chính trị và đạo đức

Trước hết là trách nhiệm cá nhân: Cuộc tấn công không cấu thành tội ác chiến tranh. Giả sử như cuộc tấn công này vi phạm LAC, thì người phát động tấn công phải chịu trách nhiệm, chứ sẽ không có binh sĩ Mỹ nào bị kết án vì hành vi này. Ngoài các vấn đề về thẩm quyền tài phán thì việc vi phạm nguyên tắc thận trọng hay những sai sót dẫn đến vi phạm LAC không được coi là tội ác chiến tranh theo luật hình sự quốc tế.

Yếu tố vật chất của hành vi là rõ ràng, nhưng yếu tố tinh thần - tức ý chí phạm tội - lại không được thể hiện. Chế độ trách nhiệm hình sự quốc tế hiện nay không công nhận trách nhiệm do sơ suất. Tuy nhiên, cách tiếp cận mang tính thực dụng này có thể thay đổi trong tương lai. Một mặt, nếu các sai sót thuật toán trong việc xác định mục tiêu ngày càng gia tăng, sẽ ngày càng khó để viện dẫn tính hợp lý của sai lầm và tiếp tục sử dụng một hệ thống đã biết là có lỗi có thể bị xem như một dạng ý chí gián tiếp nhắm vào dân thường. Mặt khác, pháp luật có thể phát triển theo hướng trừng phạt những quân nhân gây ra cái chết cho dân thường do sự cẩu thả của mình.

Tiếp đến là vai trò của các công ty tư nhân chuyên về AI, hiện đang nắm giữ phần lớn năng lực công nghệ được sử dụng trên chiến trường. Các công ty này có thể bị truy cứu trách nhiệm khi phát triển những hệ thống có sai sót. Nhưng, vượt ra ngoài trách nhiệm pháp lý, còn có một câu hỏi đạo đức và chính trị cốt lõi liên quan đến việc bán công nghệ AI cho mục đích quân sự.

Ngay trước khi Mỹ tham chiến, Anthropic - công ty phát triển mô hình AI tạo sinh Claude - đã phản đối việc hợp tác không giới hạn với Lầu Năm Góc, đặc biệt trong lĩnh vực vũ khí tự động, với lý do các cam kết đạo đức và những hạn chế về độ tin cậy kỹ thuật của hệ thống. Khi đó, Lầu Năm Góc đã cáo buộc Anthropic “phản bội”, dù các hệ thống của họ vẫn tiếp tục được quân đội sử dụng.

Trong khi đó, các công ty lớn khác như OpenAI, Google, Amazon hay Microsoft dường như đã dễ dàng hợp tác với quân đội Mỹ mà không đặt ra nhiều điều kiện, trên thực tế đang dần trở thành những “nhà thầu quốc phòng” thực thụ. Điều đáng chú ý là các doanh nghiệp - thường bị chi phối bởi lợi nhuận - đôi khi lại tỏ ra thận trọng hơn về mặt đạo đức so với một số quốc gia được kỳ vọng bảo vệ lợi ích chung.

Cuối cùng, vẫn phải nhắc đến trách nhiệm của nhà nước, nhất là ở khía cạnh ngăn ngừa vi phạm trong tương lai. Các quốc gia phát triển và sử dụng AI quân sự phải gánh vác một trách nhiệm đặc biệt. Trong trường hợp này, Mỹ phải chịu trách nhiệm quốc tế đối với hành vi vi phạm luật quốc tế cho dù việc thực thi trách nhiệm này trên thực tế sẽ rất khó khăn. Ngoài khía cạnh này, còn tồn tại một trách nhiệm mang cả tính pháp lý lẫn chính trị. Theo Điều 1 chung của các Công ước Geneva, các quốc gia có nghĩa vụ không chỉ tôn trọng mà còn phải đảm bảo việc tôn trọng LAC. Vậy mà sự phát triển của AI quân sự lại có xu hướng là suy yếu nghĩa vụ này, thậm chí có thể tạo điều kiện cho các vi phạm và che giấu chúng.

Có nhiều cơ chế có thể giúp hạn chế vấn đề này, chẳng hạn như đào tạo quân nhân về đặc thù của các hệ thống AI, xây dựng quy tắc tác chiến dành riêng cho AI, cung cấp các đảm bảo kỹ thuật về độ tin cậy và tính minh bạch của hệ thống, cũng như tiến hành kiểm tra và đánh giá định kỳ. Nhiều sáng kiến quốc tế đã kêu gọi đưa những biện pháp này vào các công cụ pháp lý mới. Tuy nhiên, ý chí chính trị còn thiếu, đặc biệt là ở các quốc gia đi đầu trong phát triển và sử dụng AI quân sự.

Nhưng, thực tế cho thấy dường như Bộ trưởng Chiến tranh Mỹ Pete Hegseth lại đang hành động theo chiều hướng ngược lại. Khi ông sa thải các cố vấn pháp lý quân sự vì đã “cản trở hoạt động tác chiến”, đồng thời gọi các quy tắc tác chiến là “ngu ngốc”. Nói rộng hơn, Mỹ đã phản đối mọi nỗ lực xây dựng khuôn khổ pháp lý quốc tế điều chỉnh AI quân sự. Vì vậy, AI vừa là động lực, vừa là dấu hiệu cho thấy sự xói mòn sâu sắc của LAC.

Thảm kịch tại Minab là một sự kiện đau lòng, xác nhận những rủi ro mà các chuyên gia về AI quân sự đã cảnh báo suốt nhiều năm qua và lẽ ra phải tạo ra phản ứng mạnh mẽ hơn. Vậy mà thông tin này dường như đã bị lu mờ bởi những mối quan tâm khác được xem là cấp bách và dễ thấy hơn trong cuộc chiến, đặc biệt là nguy cơ hạt nhân. Vụ việc Minab đã không trở thành “cú sốc” cần thiết để thúc đẩy các quốc gia đạt được một khuôn khổ pháp lý cụ thể cho AI quân sự.

“Cyber warfare” và quy luật mới của chiến tranh hiện đại

“Cyber warfare” và quy luật mới của chiến tranh hiện đại  Trận địa mới trên bản đồ chiến tranh hiện đại

Trận địa mới trên bản đồ chiến tranh hiện đại