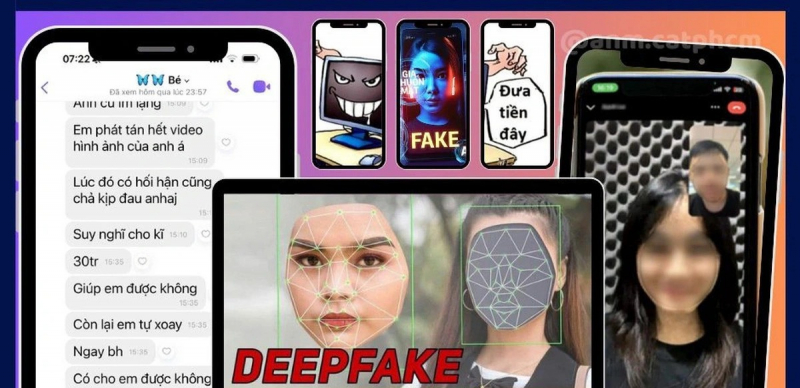

Cẩn thận trò tống tiền từ Deepfake

Với khả năng hoán đổi, cắt ghép gương mặt của một người vào người khác, công nghệ Deepfake ngày càng trở nên nguy hiểm. Thời gian vừa qua, nhiều người dân đã phải làm đơn kêu cứu đến các cơ quan chức năng phản ánh về việc mình bị các đối tượng dùng công nghệ Deepfake ghép vào các hình ảnh, clip nhạy cảm với mục đích tống tiền. Trước tình trạng này, công an nhiều địa phương đã lên tiếng cảnh báo người dân.

Cắt ghép hình ảnh nhạy cảm để tống tiền

Đối tượng lừa đảo ẩn danh trên mạng xã hội theo dõi “con mồi” trong thời gian dài, vờ gửi yêu cầu kết bạn, chia sẻ hoàn cảnh khó khăn, đáng thương của gia đình... Từ đó, các đối tượng đã lừa nạn nhân để lấy nội dung từ các tài khoản Facebook, Zalo... Cụ thể, đối tượng copy hình ảnh cá nhân được chủ tài khoản đăng công khai trên trang của họ, sử dụng Deepfake AI để ghép các hình ảnh đó thành clip hoặc hình ảnh nhạy cảm, gửi cho những người thân quen của nạn nhân nhằm mục đích khủng bố tinh thần, đe dọa, tống tiền qua mạng xã hội.

Mới đây, Trung tâm xử lý tin giả, thông tin xấu độc Việt Nam - VAFC đã nhận được phản ánh từ ông Q.T.L về việc ông bị một số đối tượng phát tán trên mạng xã hội những hình ảnh giả mạo được cắt ghép, xử lý qua công nghệ Deepfake, với mục đích bôi nhọ danh dự, nhân phẩm và uy tín cá nhân.

Không những thế, các đối tượng này sau đó còn tiếp tục sử dụng những hình ảnh giả mạo để thực hiện hành vi tống tiền, yêu cầu ông Q.T.L chuyển tiền vào ví điện tử của chúng và liên hệ qua email để xác nhận. Trung tâm xử lý tin giả, thông tin xấu độc Việt Nam cũng cho biết thêm, đơn vị đang phối hợp với các cơ quan chức năng để điều tra làm rõ vụ việc của ông Q.T.L và xử lý nghiêm các đối tượng vi phạm theo quy định của pháp luật.

Công an TP Hồ Chí Minh cho biết, thời gian qua đơn vị này liên tục tiếp nhận trình báo của nhiều nạn nhân cầu cứu về việc bị “Deepfake AI” (công nghệ ứng dụng trí tuệ nhân tạo) ghép hình vào clip nhạy cảm, dọa gửi cho người thân quen của nạn nhân trên mạng nhằm mục đích tống tiền.

Mới đây nhất là trường hợp anh N.H (TP Hồ Chí Minh) đến cơ quan Công an trình báo về việc bị một đối tượng trên mạng xã hội sao chép nhiều hình ảnh cá nhân từ trang Facebook và trang Zalo của mình. Đối tượng sử dụng Deepfake AI để ghép clip hoặc hình ảnh nhạy cảm rồi đe dọa gửi cho bạn bè, người quen của anh H trên Facebook, Zalo và tống tiền 150 triệu đồng.

Trong đơn trình báo anh H cho biết, trước đó nhận được tin nhắn mời kết bạn từ tài khoản Facebook “Lê T Uyên”. Trong những lần nói chuyện, Uyên thường xuyên chia sẻ về hoàn cảnh gia đình. Cụ thể, theo lời Uyên, cha “cô” mắc bệnh ung thư nặng giai đoạn cuối, nằm điều trị ở bệnh viện, mẹ cũng đang bị bệnh ở quê, bản thân Uyên không đủ tiền lo cho cha mổ, không có tiền để cứu cha khỏi “lưỡi hái tử thần”. Hoàn cảnh khó khăn của Uyên đã làm anh H cảm động bởi cách nói chuyện rất chân thành, thiện tâm, hết lòng muốn cứu cha cô thoát chết.

Qua trao đổi, sau khi lấy được lòng tin của anh H, đối phương ngỏ ý xin số tài khoản Viber cá nhân của anh H. Từ đó, đối tượng dùng thủ đoạn kỹ thuật xâm nhập vào điện thoại của anh H để chiếm đoạt thêm thông tin khác ngoài số hình ảnh, clip mà anh H quay với các đối tác, bạn bè đã đăng trên Facebook.

Từ trang cá nhân trên Zalo, Facebook, đối tượng lấy được danh sách bạn bè, người quen của anh H và sử dụng công nghệ Deepfake AI để ghép thành những hình ảnh, clip nhạy cảm. Lúc này, đối tượng đe dọa sẽ gửi các clip, hình ảnh nhạy cảm đến danh sách người quen của anh H, buộc anh phải chuyển 150 triệu đồng để đổi lấy việc đối tượng không phát các clip, hình ảnh nhạy cảm đó. Do không có tiền để chuyển cho đối tượng, bị làm phiền nhiều lần nên anh H. quyết định trình báo vụ việc đến cơ quan công an.

Trước đó, vào tháng 5/2024, ông L.V.T (trú tại quận 10, TP. Hồ Chí Minh), cũng đã đến cơ quan Công an trình báo về việc bị đối tượng làm quen qua mạng xã hội Facebook, sử dụng hình ảnh của một người mẫu nổi tiếng lừa đảo và tống tiền.

Ông T. khai đã cùng người này trò chuyện nhiều lần qua video call nên tin tưởng. Sau thời gian làm quen, lợi dụng lúc ông T. say rượu, người đó đã dẫn dụ ông chat sex. Sau đó đối tượng sử dụng clip và hình ảnh đó để liên tục yêu cầu ông T. phải chuyển tiền nhiều lần và dọa nếu không chuyển tiền sẽ chuyển clip đến người thân và mạng xã hội của ông T. Do lo sợ sẽ ảnh hưởng đến uy tín và danh dự, ông T đã phải chuyển hơn 450 triệu đồng. Dù đã nhận được tiền nhưng đối tượng tiếp tục khống chế đòi hỏi thêm nên ông T. trình báo Công an.

Một trường hợp khác là anh H.V.K (trú tại quận Gò Vấp). Anh K. cũng từng có thời gian hoảng loạn vì bỗng dưng trở thành nạn nhân của công nghệ Deepfake. Cụ thể, vào một ngày, anh K. nhận được tấm ảnh gửi qua messenger (ứng dụng nhắn tin, gọi điện của Facebook), khi mở ra thì anh tá hỏa vì đó là tấm hình mình đang khỏa thân. Người gửi anh K. tấm ảnh này yêu cầu anh chuyển khoản 5 triệu đồng nếu không sẽ gửi hình ảnh này cho bạn bè của anh trên mạng xã hội.

Tìm hiểu về hình thức này, anh H.V.K cho biết, khuôn mặt anh trên tấm hình này được cắt ghép trong tấm ảnh khỏa thân nêu trên có khả năng bị đối tượng lấy từ ảnh đại diện của anh trên Facebook. “Khi thấy hình ảnh đó, tôi rất sợ. Mặc dù biết đó không phải mình nhưng nếu đối tượng gửi cho bạn bè thì họ sẽ không biết. 5 triệu đồng cũng là số tiền lớn với tôi nên tôi nhắn đối tượng xin hoãn việc chuyển tiền”, anh K kể lại.

Sau đó, anh H.V.K. trình báo sự việc với Công an. Tuy nhiên, vì địa chỉ IP (Internet Protocol-giao thức Internet) bị giả mạo cho nên việc tìm kiếm người đứng sau vụ tống tiền này rất khó. Cán bộ Công an khuyên anh, để xử lý việc này, anh K. nên đăng bài đính chính tấm ảnh deepfake khỏa thân này lên trang Facebook của mình để thông báo cho mọi người đây là hình ảnh giả mạo. Qua một thời gian, anh K. chưa nhận được phản hồi từ đối tượng tống tiền hay thông báo của bạn bè về việc bị tung ảnh deepfake nhạy cảm. Tuy nhiên, vì lo lắng sự việc có thể tái diễn, anh K. quyết định xóa tài khoản cũ, tạo tài khoản mới, giới hạn vòng bạn bè và cẩn trọng hơn với việc đăng ảnh cá nhân lên mạng xã hội.

Hiện nay, nhiều bác sĩ cũng trở thành nạn nhân của công nghệ này. Cụ thể, các đối tượng xấu giả làm bệnh nhân gọi video nhờ tư vấn khám bệnh để lấy hình ảnh các bác sĩ, sau đó cắt ghép thành những hình ảnh, video nhạy cảm tống tiền.

Cần báo ngay cho cơ quan chức năng

Trong kỷ nguyên số, công nghệ deepfake đang nổi lên như một mối đe dọa mới với nhiều ứng dụng tiềm ẩn nguy hiểm, trong đó có lừa đảo và tống tiền. Deepfake là công nghệ sử dụng trí tuệ nhân tạo (AI) để tạo ra các video, hình ảnh hoặc âm thanh giả mạo nhưng trông rất chân thực. Khả năng tái tạo giọng nói, khuôn mặt và hành động của người khác đã mở ra cánh cửa cho nhiều hành vi phi pháp, bao gồm cả việc sử dụng deepfake để lừa đảo và tống tiền.

Cụ thể, các đối tượng xấu có thể tạo ra video hoặc âm thanh giả mạo của nạn nhân, sau đó dùng nó để tống tiền hoặc gây tổn hại đến danh dự, uy tín của họ. Ví dụ, một video deepfake có thể giả mạo cảnh một người đang tham gia vào một hành vi không đứng đắn, hoặc một bản ghi âm giả có thể tạo ra những lời nói không thật. Sau khi tạo ra những tài liệu giả này, kẻ lừa đảo sẽ liên hệ với nạn nhân, yêu cầu họ trả tiền để ngăn chặn việc phát tán những thông tin giả mạo này trên mạng.

Điểm nguy hiểm của deepfake nằm ở chỗ nó có thể dễ dàng lừa dối người xem hoặc người nghe, khiến họ tin rằng những gì họ thấy hoặc nghe là thật. Công nghệ này đã tiến bộ đến mức mắt thường khó có thể phát hiện ra sự giả mạo. Điều này đặc biệt nguy hiểm trong bối cảnh lừa đảo và tống tiền, nơi mà một bằng chứng hình ảnh hoặc âm thanh giả mạo có thể khiến nạn nhân hoang mang, sợ hãi và chấp nhận trả tiền để tránh bị bôi nhọ hoặc tiết lộ thông tin.

Một số nạn nhân còn bị các tổ chức lừa đảo giả danh là thám tử tư gọi điện thoại thông báo về việc phát hiện người này có mối quan hệ bất chính với những người phụ nữ khác. Đối tượng gửi cho nạn nhân các hình ảnh nhạy cảm đã được chỉnh sửa, cắt ghép có sử dụng hình ảnh khuôn mặt của nạn nhân.

Sau đó, các đối tượng lừa đảo yêu cầu nạn nhân phải chuyển một khoản tiền điện tử với giá trị tương đương hàng tỷ đồng vào ví điện tử để không bị đăng lên mạng xã hội. Khi nạn nhân bị “sập bẫy”, các đối tượng sẽ hướng dẫn mua tiền điện tử, chuyển đến các tài khoản ví điện tử theo chỉ định để chiếm đoạt.

Cùng với khuyến cáo người dân nâng cao cảnh giác, Trung tâm xử lý tin giả, thông tin xấu độc Việt Nam cũng lưu ý về một số biện pháp phòng ngừa: Cẩn trọng với những yêu cầu kết bạn từ người lạ trên mạng xã hội; không chia sẻ thông tin cá nhân, hình ảnh, video riêng tư với người không quen biết; kiểm tra kỹ nguồn gốc thông tin, hình ảnh, video trước khi chia sẻ.

Ngoài ra, khi phát hiện các trường hợp nghi ngờ lừa đảo, tống tiền bằng Deepfake, người dân cần báo ngay cho cơ quan chức năng. Trường hợp người dân đã trở thành nạn nhân của hình thức lừa đảo, tống tiền bằng hình ảnh, video giả mạo được tạo ra từ việc sử dụng công nghệ Deepfake, Trung tâm xử lý tin giả, thông tin xấu độc Việt Nam khuyên người dân giữ lại tất cả bằng chứng liên quan như tin nhắn, email, hình ảnh, video...; không chuyển tiền cho kẻ tống tiền và liên hệ ngay với cơ quan Công an gần nhất để được hỗ trợ.

Việc sử dụng deepfake để lừa đảo và tống tiền là vô cùng nghiêm trọng. Nạn nhân không chỉ mất tiền mà còn có thể bị tổn hại về danh dự, uy tín. Các vụ việc này còn tạo ra sự hoang mang trong cộng đồng, làm mất lòng tin vào các nội dung trên mạng xã hội và các phương tiện truyền thông.

Trước tình trạng này, Công an nhiều địa phương trên cả nước đã đưa ra lời cảnh báo. Cụ thể, Công an TP. Hồ Chí Minh cũng khuyến cáo người dân khi gặp các trường hợp tương tự phải nâng cao tinh thần cảnh giác với phương châm “Không hoảng sợ - Không làm theo yêu cầu chuyển tiền của đối tượng”; đồng thời, phải liên hệ ngay với cơ quan Công an nơi gần nhất để cung cấp thông tin, phối hợp nhanh chóng điều tra, xử lý. Tương tự, Công an TP Cần Thơ cũng khuyến nghị người dân không chia sẻ thông tin cá nhân lên MXH ở chế độ công khai, không truy cập vào các đường dẫn lạ (được gửi kèm trong tin nhắn hoặc email); luôn cẩn trọng khi tiếp nhận các cuộc gọi, tin nhắn từ những nguồn không quen biết, không rõ ràng.

Đe dọa dùng hình ảnh nhạy cảm để tống tiền mẹ bạn gái cũ

Đe dọa dùng hình ảnh nhạy cảm để tống tiền mẹ bạn gái cũ  Nhặt được điện thoại, tống tiền chủ nhân bằng hình ảnh nhạy cảm

Nhặt được điện thoại, tống tiền chủ nhân bằng hình ảnh nhạy cảm